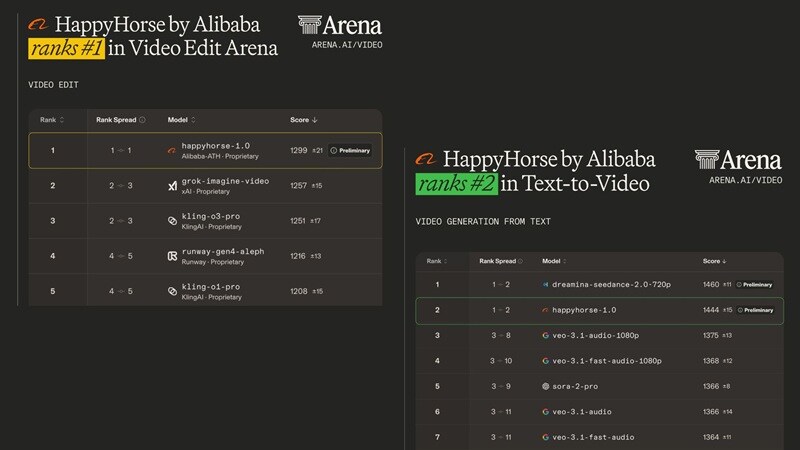

HappyHorse hat sich kürzlich als ein Kraftwerk im KI-Videoraum entwickelt und berühmt den#1-Platz auf der KI-Videoindustrie beansprucht.Künstliche Analyse Video ArenaRangliste im April 2026 für Videobearbeitung und Platz 2 sowohl für Text-zu-Video als auch für Bild-zu-Video. Dies hat eine massive Debatte ausgelöst, weil es derzeit Schwergewichte wie Googles Veo und Elons Grok schlägt, wobei nur Seedance 2.0 im Weg steht.

Natürlich tauchten überall Vergleiche wie HappyHorse 1.0 vs. Seedance 2.0 auf. Aber ist das nur ein Benchmark-Hype, oder hält es tatsächlich? Lassen Sie uns alles aufschlüsseln, damit Sie entscheiden können, ob es Ihre Zeit wert ist.

Teil 1. Lernen Sie den neuen Konkurrenten kennen: Was ist HappyHorse AI eigentlich?

HappyHorse 1.0 ist Alibabas KI-Videogenerationsmodell, das von der ATH AI Innovation Unit (insbesondere dem Future Life Lab-Team der Taotian Group) entwickelt wurde. Alibaba bestätigte die Autorschaft am 9. April 2026 offiziell. Im Gegensatz zu früheren tools wurde es entwickelt, um video und audio zusammen zu generieren, was ein großer Schritt in Richtung umfassenderer KI-Storytelling ist.

HappyHorse AI erhielt erstmals Aufmerksamkeit durch sein Debüt bei#1 in der Kategorie VideobearbeitungAuf der leaderboard der künstlichen Analyse und#2 in Text-to-Video. Und zum Zeitpunkt des Schreibens steht es auf Platz 2 bei Text-zu-Video-, Bild-zu-Video-und Videobearbeitung.

Access, GitHub & „Open-Source "-Verwirrung erklärt

Da es sich um ein neu veröffentlichtes KI-Modell mit einem plötzlichen Anstieg handelt, gibt es viele gemischte Informationen darüber, wie man darauf zugreift. Viele erwähnen Open-Source-Ansprüche wie HappyHorse Github oder HappyHorse HuggingFace. Aber ist es wahr? Nun, hier ist das genaueste Bild ab Ende April 2026:

| Thema | Die genaue Realität |

| GitHub/HuggingFace | Es gibt Organisationsseiten und Wrapper-Repos, aber keine offiziellen Modellgewichte können öffentlich heruntergeladen werden. |

| Open Access vs Open Source | Open Access = Ja, nutzen Sie es über API. Open-Source = Nein. Sie können es nicht lokal mit öffentlichen Gewichten ausführen. |

| HappyHorse 1.0 API | Enterprise beta wurde am 27. April 2026 auf Alibaba Cloud Bailian gestartet. Auch über fal.ai als offizieller launch partner verfügbar. |

| HappyHorse 1.0 Veröffentlichungsdatum | Erschienen auf Artificial Analysis leaderboard April 7, 2026. Alibaba bestätigte am 9. April 2026. Enterprise API beta: 27. April 2026. |

| Mobile App | Noch keine offizielle mobile app. Die Webschnittstelle reagiert auf mobile browser, aber es gibt keine dedizierte app. |

⚠ ️ Rote Flagge Warnung:Jede Website, die einen 'HappyHorse 1.0 GitHub oder APK'-download anbietet oder behauptet, die vollständigen Modellgewichte für die lokale Bereitstellung zu haben, ist nicht offiziell. Halten Sie sich an den offiziellen, legitimen Zugang.

Teil 2. Das Toolkit: Aufschlüsselung der HappyHorse-Funktionen

Benchmarks sind großartig für Prahlerechte, aber sie bezahlen die Rechnungen nicht; Dein content tut es. Lassen Sie uns also darüber sprechen, was HappyHorse 1.0 tatsächlich produziert und für welche Arten von Projekten es am besten geeignet ist.

Im Kern konzentriert es sich auf vier Hauptfunktionen:

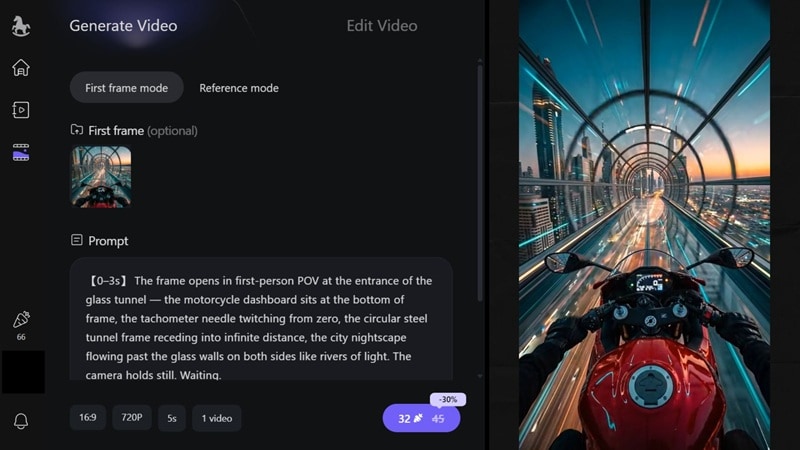

- Text-zu-Video:Beschreiben Sie jede Szene in einfacher Sprache, und HappyHorse rendert sie in einen filmischen clip. Es zeichnet sich durch komplexe Beleuchtungseinstellungen aus und folgt detaillierten Anweisungen zur Bewegung der Kamera.

- Bild-zu-Video:Laden Sie ein beliebiges statisches Bild für das erste Bild hoch, und HappyHorse AI animiert es zu einem kurzen Videoclip. Das Ergebnis? Gesichter treiben oder verändern sich nicht, die Farben bleiben dem original treu und die Bewegung fühlt sich organisch an, anstatt künstlich aufgepfropft zu sein.

- Verweis auf Video:Laden Sie ein Referenzcharakterbild oder ein Beispiel für einen visuellen Stil hoch, und HappyHorse stellt sicher, dass Ihr generiertes video dem spezifischen look und der Identität entspricht. Dies ist leistungsfähig für Markeninhalte und charaktergesteuertes storytelling.

- Videobearbeitung:Anstatt Bild-für-Bild-Bearbeitung können Sie Ihren clip hochladen und die gewünschte Änderung beschreiben und die KI damit umgehen lassen. Sie können das outfit eines Charakters tauschen oder sogar das Wetter von sonnig zu stürmisch ändern.

Unterstützte Spezifikationen (kurze Übersicht)

| Merkmal | Fähigkeit |

| Auflösung | 720P (Standard) & 1080P (High-Definition) |

| Dauer | 3 bis 15 Sekunden pro clip |

| Seitenverhältnisse | 16:9, 9:16, 1:1, 4:3, 3:4 |

| Batch-Ausgabe | 1 bis 4 Variationen auf einmal |

Teil 3. HappyHorse Preisgestaltung: kostenlos vs bezahlt

Wir alle lieben kostenlose tools, aber High-End-KI-Video erfordert ernsthafte Rechenleistung. Bevor Sie also einspringen, lohnt es sich zu wissen, wie weit Sie HappyHorse tatsächlich nutzen können, ohne bezahlen zu müssen.

🎁 Kostenloser Plan (Starter-Zugang)

Wenn Sie sich anmelden, erhalten Sie in der Regel:

- ~66 kostenlose credits & tägliche Login-Boni.

- Bis zu 2 parallelen Generationen.

Beschränkungen:Nur 720p, Wasserzeichen enthalten und keine Batch-Generierung.

Bezahlte Pläne: Standard vs Pro

Wenn Sie auf der Suche sind, professionell zu werden, hier ist, wie die Ebenen aufgeteilt werden:

| Merkmal | Standardplan | Pro-Plan |

| Monatspreis | $12.50 | $50 |

| Jahrespreis | $150 | $600 |

| Monatliche Gutschriften | 875 | 3500 |

| Auflösung | Bis zu 1080p | Bis zu 1080p |

| Wasserzeichen | entfernt | entfernt |

| Geschwindigkeit | schnell | schnellste |

| Batch-Ausgabe | verfügbar | verfügbar |

| Parallelgenerationen | 10 | unbegrenzt |

Entwickler-API-Preise (WaveSpeedAI/Alibaba Cloud Bailian)

Für Entwickler, die HappyHorse direkt in ihre eigenen apps oder workflows integrieren, werden die API-Preise pro Sekunde des generierten Videos berechnet, die nach der Auflösung skaliert werden:

| Auflösung | Kosten/5 Sekunden | 3s Clip | 5s Clip | 10s Clip | 15s Clip |

| 720P | $0.70 pro 5s | $0.42 | $0.70 | $1.40 | $2.10 |

| 1080P | $1,40 pro 5s | $0.84 | $1.40 | $2.80 | $4.20 |

Auf Alibaba Cloud Bailian (der offiziellen chinesischen Unternehmensplattform) beträgt der API-Preis ¥0,9/Sekunde für 720p und ¥1,6/Sekunde für 1080p, wobei eine einfache Formel für Menge × Sekunden × Stückpreis verwendet wird. Die Bild-zu-Video-API-Preise werden voraussichtlich während der vollständigen kommerziellen phase im Mai 2026 bekannt gegeben.

Teil 4. HappyHorse 1.0 vs. Seedance 2.0: Wer gewinnt eigentlich?

Dies ist die Frage, die derzeit jede KI-Video-Community beleuchtet. Across happyhorse 1.0 Reddit Diskussionen (Gefällt mirr/HappyHorse_AI), vergleichen Benutzer es ständig mit Seedance 2.0, da beide die Rangliste dominieren.

Ein X-Benutzer mit dem NamenGenelMachte einen direkten Happy Horse 1.0 vs Seedance 2.0 Vergleich mit der gleichen Eingabeaufforderung, die die Ergebnisse nebeneinander zeigte.

Ein Reddit-Benutzer,zeroludesigner, stellte fest, dass Seedance 2.0 zu diesem Zeitpunkt immer noch genauer in details wie der Bewegung des Hundemundes beim Essen und dem physischen Verhalten von Gegenständen wie einem toaster erscheint.

📊 Head-to-Head-Benchmark-Daten

Auf der Artificial Analysis Video Arena leaderboard finden Sie hier, wie sich die beiden in drei Kategorien nebeneinander verglichen haben.

| Kategorie | HappyHorse 1.0 Ergebnis | Seedance 2.0 Ergebnis | HappyHorse 1.0 Stimmen | Seedance 2.0 Stimmen |

| Text-zu-Video | 1444 | 1460 | 1,843 | 6,836 |

| Bild-zu-Video | 1444 | 1454 | 4,216 | 18,176 |

| Video Bearbeitung | 1302 | 1362 | 761 | 506 |

💬 Unsere Erkenntnisse

Reddit-Nutzerzeroludesigner postete einen Direktvergleich von Seedance 2.0 und Happy Horse 1.0 mit exakt demselben Prompt, und die Unterschiede sind ziemlich klar.

So interpretieren wir diese Ergebnisse:

| Szenario | Gewinner | Warum |

| Kinematischer Kurzclip | HappyHorse 1.0 | Bessere Bewegung + Beleuchtung |

| Charakterkonsistenz | Seedance 2.0 | Stärkere Referenzbehandlung |

| Mehrere Aufnahmen | Seedance 2.0 | Strukturiertes Ergebnis |

| Stilisierte Optik | HappyHorse 1.0 | Kreativere Ergebnisse |

Vor- und Nachteile von HappyHorse

- Beste kinematische Bewegungen: Menschliche Bewegungen, Fluiddynamik und Objektinteraktionen bleiben während der Clips physikalisch plausibel.

- Audio + Video gemeinsam: Dialog, Umgebungsgeräusche und Foley-Effekte werden in einem Durchlauf erzeugt.

- Mehrsprachige Lippen-Synchronisation: Lippenbewegungen werden an die Ziellautfolgen in 7 Sprachen angepasst (Mandarin, Kantonesisch, Englisch, Japanisch, Koreanisch, Deutsch, Französisch).

- Physik kann fehlerhaft sein: Komplexe Bewegungen sind nicht immer exakt. Gelegentliche "physikalische Fehler" in Clips über 10 Sekunden.

- API noch in Entwicklung: API und Plattform entwickeln sich noch weiter. Es fehlt ihr an Stabilität und Tiefe im Entwickler-Ökosystem, wie sie Seedance 2.0 über mehrere Versionen aufgebaut hat.

- Keine expliziten Multi-Shot-Regie-Controls: HappyHorse leitet Kamerabewegungen aus der Promptbeschreibung ab, was bei komplexen narrativen Sequenzen, die Präzision verlangen, weniger zuverlässig ist.

Teil 5. Möchten Sie selbst vergleichen? Testen Sie Seedance 2.0 in Filmora

Alle oben genannten Vergleiche zwischen HappyHorse 1.0 und Seedance 2.0 basieren auf Benchmark-Daten, Community-Feedback und praktischen Tests. Aber am Ende zählt nur der Vergleich, den Sie selbst durchführen – mit Ihrer eigenen kreativen Vision.

Die beste Möglichkeit, dies jetzt zu tun, ohne zwischen mehreren Plattformen und Konten zu wechseln, ist durch Wondershare Filmora, das Seedance 2.0 direkt in einen vollständigen Videoproduktions-Workflow integriert hat.

So nutzen Sie Seedance 2.0 in Filmora

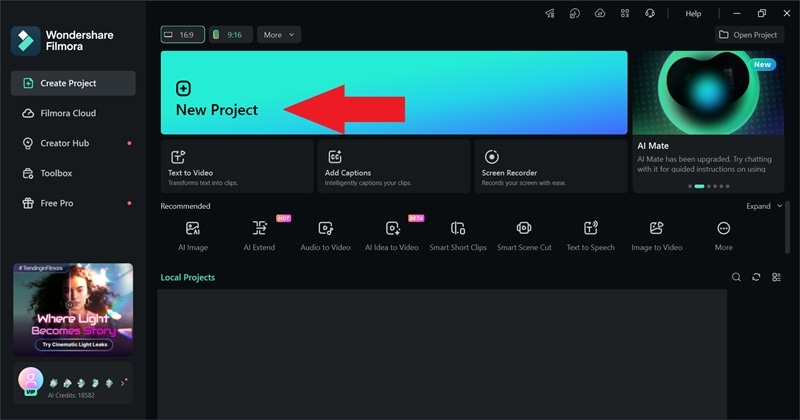

Schritt 1. Starten Sie in Filmora

Laden Sie Filmora auf Ihr Gerät herunter und installieren Sie es. Nach der Installation öffnen Sie die App und klicken auf „Neues Projekt“, um zu beginnen.

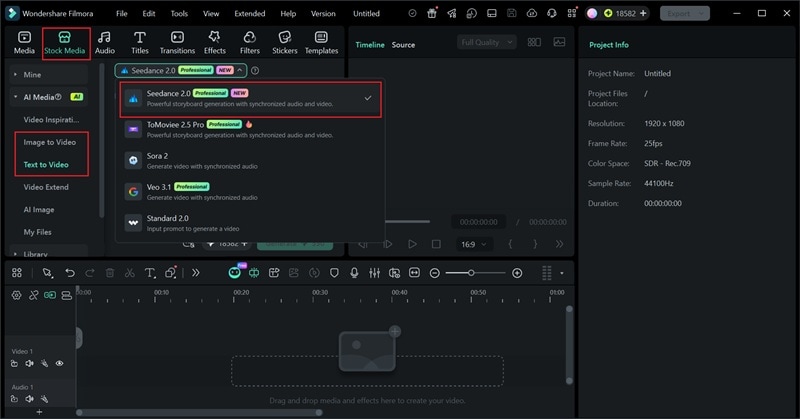

Schritt 2. Erstellen mit Seedance 2.0

Gehen Sie zu Stock-Medien, dann wählen Sie entweder Text-zu-Video or Bild-zu-Video. Dort wählen Sie Seedance 2.0 als Modell.

Geben Sie Ihren Prompt ein und klicken Sie auf Erstellen. Wenn Sie eine detaillierte Anleitung wünschen, sehen Sie sich das Video unten an.

Was Filmora bietet, was KI-Generatoren nicht liefern

1. Mühelose Erstellung von Smart Short Clips

Filmoras KI Smart Kurzclips analysiert Ihre Langformat-Aufnahmen: Interviews, Vlogs, Podcasts, Tutorials – und schneidet sie automatisch in ansprechende, plattformoptimierte Kurzclips. Statt stundenlang nach Highlights im Zeitstrahl zu suchen, erkennt die KI Energie-Spitzen, Schlüsselpunkte und dynamische Momente in Sekunden. Kombinieren Sie dies mit Seedance-generiertem B-Roll und Sie haben eine komplette Kurzformat-Content-Engine, ohne Filmora zu verlassen.

2. Echter Bearbeitungs-Zeitstrahl (Das zählt)

KI-generierte Clips sind auf maximal 15 Sekunden limitiert. Das ist ein Teaser, aber kein fertiges Video. Filmoras Multitrack-Zeitstrahl verändert alles. Sie können mehrere KI-Clips zu einer kohärenten Geschichte stapeln, mit echten Aufnahmen mischen, sanfte Übergänge hinzufügen, Musik und Sounddesign Layern und das Timing bis zum Frame genau einstellen.

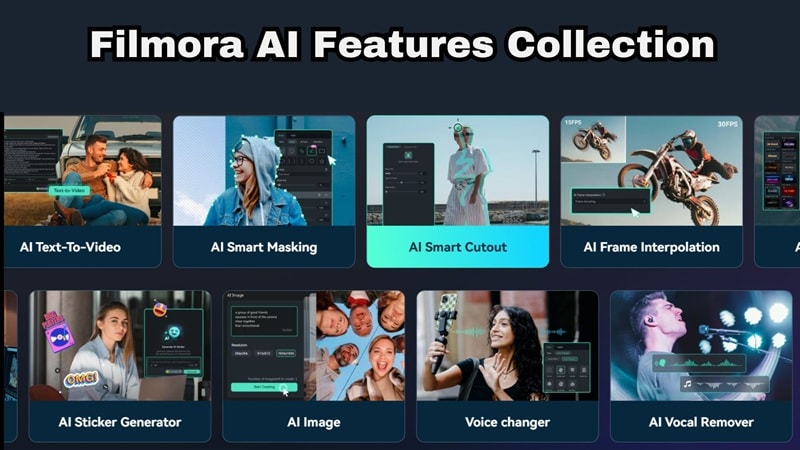

3. KI-Tools, die den Job tatsächlich erledigen

Über die Clip-Erstellung hinaus erledigt die integrierte KI-Suite von Filmora jeden Produktionsschritt bis zum Abschluss. Sie erhalten:

- KI Untertitel: Transkribiert und synchronisiert Untertitel automatisch und spart aufwändige manuelle Beschriftung.

- KI Video Übersetzer: Wandelt Ihren Content in mehrere Sprachen um für weltweite Verbreitung.

- KI Musik Generator: Erstellt originelle, stimmungsangepasste Hintergrundmusik, die sich wie speziell für Ihr Video komponiert anfühlt.

- KI Video Verbessere: Schärft und skaliert Aufnahmen für Broadcast-Qualität.

- KI Video Verlängerer: Fügt intelligent Frames hinzu, um die Clipdauer ohne sichtbare Übergänge oder Artefakte zu verlängern.

4. Entwickelt für soziale Medien

Filmora ist nicht nur ein Editor, sondern ein Publishing-Toolkit. Verlassen Sie sich auf diese Features für Ihre Social-Media-Präsenz:

- Social Content Planner: Ermöglicht das Planen von Beiträgen über YouTube, TikTok, Instagram und mehr im Dashboard, ohne zwischen verschiedenen Planungstools zu wechseln.

- KI Thumbnail Maker: Findet automatisch die auffälligsten Frames Ihres Videos und generiert klickoptimierte Vorschaubilder.

- Auto Reframe: Konvertiert Ihr Video blitzschnell in alle wichtigen Seitenverhältnisse – ein Projekt, jede Plattform, keine manuelle Anpassung.

5. Cross-Plattform-Workflow

Filmora ist sehr flexibel in puncto Kompatibilität. Sie starten Ihr Projekt auf Windows or macOS mit voller Desktop-Bearbeitungsleistung. Sie können auf Ihrem iPhone or Android Tablet unterwegs weiterarbeiten. Projekte synchronisieren sich über die Cloud – Sie müssen nie warten, bis Sie wieder an Ihrem Hauptgerät sind.

6. Plugin-Ökosystem-Support

Wenn Ihre kreative Vision Standard-Tools übersteigt, ist das Filmora-Plugin-Ökosystem für Sie da. BorisFX Integration bringt branchenübliche visuelle Effekte, Motion Graphics und Compositing-Tools aus professioneller Film- und Fernsehproduktion.NewBlueFXfügt fortschrittliche Color-Grading-Arbeitsabläufe, hochwertiges Titling und dynamische Übergänge hinzu, die KI-generierte Inhalte auf ein kommerzielles Niveau heben.

Fazit

HappyHorse 1.0 ist derzeit eines der aufregendsten KI-Videomodelle. Und die Spitzenleistungen auf der Rangliste werden durch echte Nutzerabstimmungen bestätigt, nicht durch selbst gemeldete Benchmarks. Wenn Sie Wert auf beeindruckende filmische Optik, flüssige, physikalisch stimmige Bewegungen oder mehrsprachiges Lippen-Synchronisieren in sieben Sprachen legen, ist HappyHorse aktuell die stärkste verfügbare Option.

Allerdings ist ein großartiger Clip nichts ohne einen großartigen Schnitt. Deshalb ergibt die Kombination mit einem Tool wie Filmora Sinn. Sie können Clips mit HappyHorse AI generieren und sie dann verfeinern, erweitern und zu tatsächlich nutzbaren Ergebnissen bearbeiten. Wenn Sie HappyHorse als leistungsstarken Clip-Generator und nicht als Komplettlösung betrachten, holen Sie das meiste aus dem Tool heraus.

FAQs

-

Kann ich HappyHorse 1.0 von GitHub herunterladen?

Nicht über einen offiziellen oder sicheren Kanal. Es gibt zwar GitHub-Repositories und HuggingFace-Organisationsseiten unter dem Namen HappyHorse, aber bis April 2026 wurden keine offiziellen Modellgewichte zur lokalen Nutzung oder zum Self-Hosting öffentlich veröffentlicht. -

Kann ich HappyHorse 1.0 für kommerzielle Projekte verwenden?

Das hängt von der Plattform ab, über die Sie darauf zugreifen. Ein API-basierter Zugang könnte die kommerzielle Nutzung erlauben, aber die Bedingungen variieren. -

Wie funktioniert die Lippen-Synchronisation, wenn ich keine Audiodatei hochlade?

HappyHorse leitet die passende Sprachwiedergabe, emotionale Betonung und akustische Umgebung aus Ihrem Texteingabe und der erzeugten visuellen Szene ab.