Einführung:MeisterSo verwenden Sie DALL-E 32026 mit unserem aktualisierten Leitfaden. Seit GPT-4o und GPT Image 1.5 zu den Standardeinstellungen wurden, hat sich der Zugriff auf das ursprüngliche DALL-E-Modell geändert. Ob du willstKI-Bilder kostenlos generierenÜber Bing oder ChatGPT deckt dieses tutorial die neuesten workflows ab und zeigt Ihnen, wie Sie KI-Visuals in IhreVideobearbeitungProjekte mitFilmora.

Teil 1. So verwenden Sie DALL-E über ChatGPT

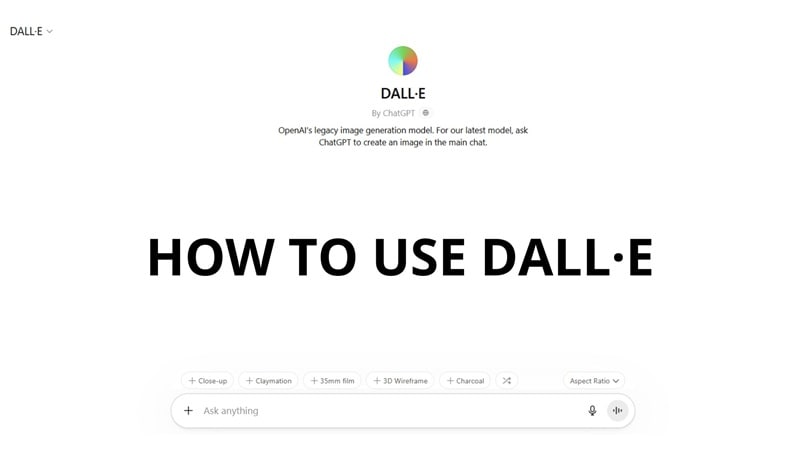

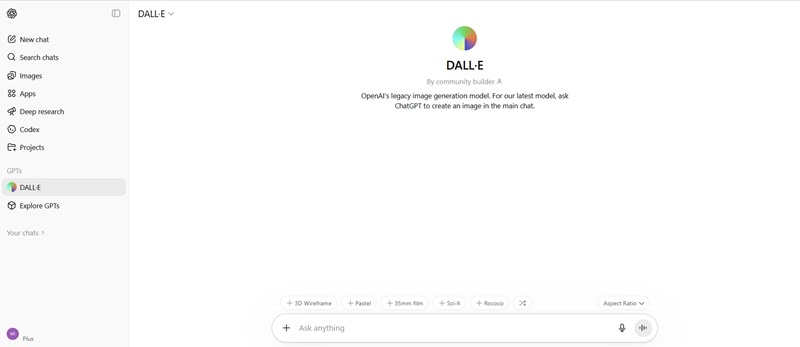

DALL-E ist eigentlich immer noch in ChatGPT, aber es ist nicht auf der üblichen Bilderzeugungsoberfläche. Wenn Sie Bilder auf ChatGPT generieren, verwenden Sie tatsächlich GPT-4o oderGPT-Bild 1.5, das neueste Bilderzeugungsmodell von OpenAI.

Um DALL-E speziell in ChatGPT zu verwenden, müssen Sie dieDALL-E GPT, was ein separater Einstiegspunkt vom Hauptchat-Fenster ist. Diese dedizierte GPT ist jedoch nicht spezifisch für DALL-E 2 oder DALL-E 3, da alles unter einem einheitlichen „DALL-E "-Modell konsolidiert ist.

So verwenden Sie DALL-E kostenlos über ChatGPT

Was ist, wenn Sie zurückgehen und DALL-E 2 für Ihre Bilder verwenden möchten? Wenn Sie gesucht haben, wie Sie auf DALL-E 2 zugreifen können, lautet die Antwort:Du kannst nicht.

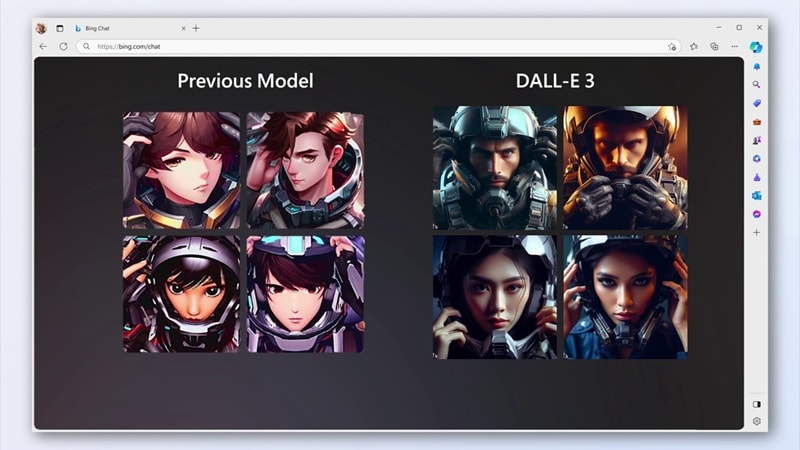

OpenAI hat Anfang 2024 DALL-E 2 zugunsten von DALL-E 3 abgeschaltet, das insgesamt deutlich bessere Ergebnisse liefert. Für alle, die noch an DALL-E 2 festhalten, ist DALL-E 3 an diesem Punkt der einzige Weg nach vorne.

Teil 2. Wie man kostenlos über Bing AI & ChatGPT auf DALL-E 3 zugreift

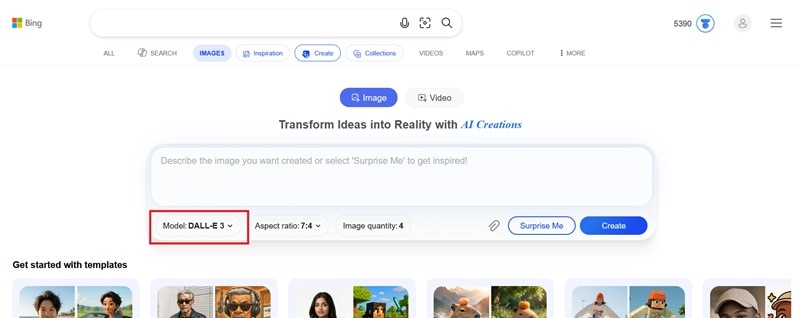

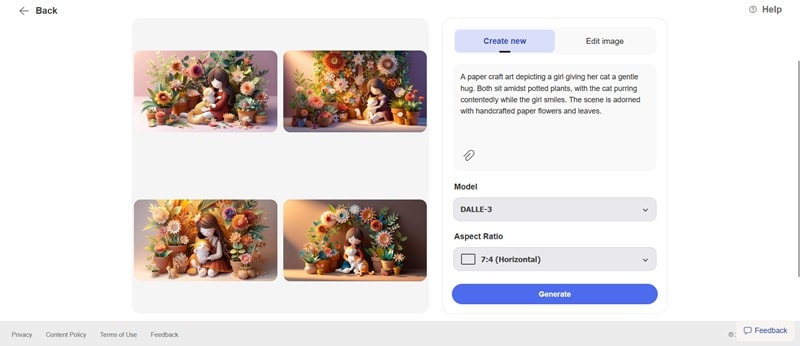

Wenn Sie das Modell DALL-E 3 gezielt nutzen möchten, können Sie dies kostenlos überBing AI Bilderzeuger. Bing AI Creator beinhaltet neben GPT-4o und MAI-Image-1 DALL-E 3 als eines seiner auswählbaren Modelle.

Wie man kostenlos auf DALL-E 3 zugreift

Teil 3. Erweiterte Tipps: DALL-E 3 Prompt Engineering Guide

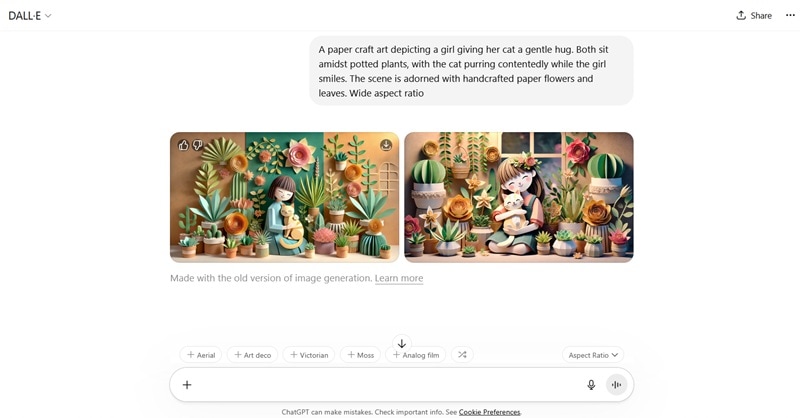

Lernen, wie man DALL-E 3 kostenlos verwendet, ist eine Sache. Das Bild zu bekommen, das Sie sich beim ersten Versuch vorgestellt haben, ist ein anderes. Es hängt vonWie gut Sie Ihre prompt schreiben. Vage Eingabeaufforderungen liefern vage Ergebnisse. Denken Sie daran, dass die KI Ihre Worte liest, nicht daran denken.

Einige Benutzer teilten ihre getesteten Techniken im OpenAI community forum mit. Die nützlichsten haben wir unten zusammengefasst.

1. Beginnen Sie mit einer klaren Aufforderungsstruktur

Je spezifischer Ihre Aufforderung ist, desto besser ist die Bildqualität. Fügen Sie details wie die Einstellung, Objekte, Farben, Stimmung und alle spezifischen Elemente ein, die Sie im Bild möchten. Eine gute Struktur, die Sie folgen können, ist:

[Thema] + [Umgebung] + [Kunststil] + [Stimmung] + [Beleuchtung] + [Kamerawinkel]

Beispiel: "Ein Straßenverkäufer auf einem Nachtmarkt in Bangkok, umgeben von hängenden Laternen und Dampf, der aus dem grill steigt. Photorealistisch, warmes goldenes Licht, Aufnahme auf Augenhöhe, geringe Schärfentiefe."

2. Verwenden Sie beschreibende Adjektive, aber überladen Sie nicht

Adjektive helfen, das Bild zu verfeinern. Anstatt "ein Hund" zu sagen, sagen Sie "ein flauschiger, kleiner, brauner Pommerier". Aber geben Sie nicht zu viele details hinzu, sonst wird das Modell verwirrt. Finden Sie ein Gleichgewicht zwischen beschreibend und prägnant. Die Faustregel lautet: Eine klare Szene mit reichen Details schlägt zwei konkurrierende Ideen, die in einer Aufforderung gepackt sind.

3. Kamera-und Beleuchtungsbegriffe, die auf DALL-E funktionieren

Die Verwendung der richtigen Kamera und des richtigen Beleuchtungsvokabulars macht einen größeren Unterschied, als die meisten Menschen erwarten. Diese Beleuchtungsbeschreibungen werden von DALL-E zuverlässig interpretiert:

- Filmbeleuchtung:Hoher Kontrast, Richtung, dramatische Schatten

- Goldene Stunde:Warmes, niedriges Sonnenlicht, lange Schatten

- Weiches diffuses Licht:Bewölkt, keine harten Schatten, gleichmäßige Belichtung

- Rembrandt Beleuchtung:Eine Seite des Gesichts beleuchtet, die andere im Schatten

- Neonleuchten:Künstliches farbiges Licht, urbane oder Sci-Fi-Szenen

- Studio Beleuchtung:Sauberer, gleichmäßiger, neutraler Hintergrund

Sie können auch Kamera-Begriffe verwenden, um die Komposition zu leiten und Ihnen mehr Kontrolle über das Endergebnis zu geben. Zum Beispiel: breite Aufnahme, enge Nahaufnahme, Überkopf/Vogelperspektive, geringe Schärfentiefe, niedriger Winkel.

Teil 4. Praktische Szenarien: Anwendung von DALL-E 3 Visual Assets in der Videoproduktion

Nun, was machen Sie eigentlich mit dem Bild, das Sie mit DALL-E generiert haben? Für Videomacher lautet die Antwort:viel.

Die Videoproduktion verlangt ständig Bilder, nicht nur für das Video selbst. Miniaturen, Storyboard-Frames, Hintergrund-Assets und Titelkarten-Grafiken sind einige Beispiele, die irgendwo kommen müssen.

Integrieren Sie DALL-E 3 Bilder in IhreKI-VideobearbeitungArbeitsablauf. Mit FilmorasBild zu VideoundSmart AusschnittWerkzeuge, können Sie statische DALL-E-Generationen in dynamische filmische Hintergründe verwandeln. Der beste Weg, diese DALL-E 3-Assets in Betrieb zu bringen, ist die Verwendung eines Videoeditors, der den workflow einfach hält.Wondershare Filmoraist genau dafür geschnitten, und Sie können es verwenden, um diese Bilder in Ihren Video-Workflow zu bringen.

Videohintergrund ersetzen

Nehmen wir an, Sie brauchen eine Hintergrundszene, die zu spezifisch ist, um in jeder Stock-Bibliothek zu existieren. Sie können DALL-E verwenden, um genau diese Umgebung in der Stimmung und dem Stil zu erzeugen, die Sie brauchen, in weniger als zwei Minuten.

Um es in ein video einzufügen, kannst du Filmorastools zum Entfernen von HintergründenUm Ihr Motiv sauber vom Originalmaterial zu trennen und das Dall-E-Bild dahinter zu platzieren. Je nach situation gibt es drei Möglichkeiten:

- Grüner Bildschirm (Chroma-Taste):Am besten verwendet, wenn Ihre Aufnahmen gegen einen einfarbigen Hintergrund gedreht wurden. Filmora entfernt die einfarbige Farbe mit einem Klick und lässt nur Ihr Motiv für den Dall-E-Hintergrund zurück.

- KI-Porträt: Funktioniert, wenn Ihr Hintergrund nicht einfarbig ist, aber auch nicht zu komplex ist. Es ist auch ein Ein-Klick-Entfernung, keine manuelle Auswahl erforderlich.

- KI intelligenter Ausschnitt:Gibt Ihnen die meiste Kontrolle. Sie können manuell markieren, was Sie behalten und was entfernen sollen, was es die richtige Wahl für komplexe Hintergründe mit feinen Kanten wie lockere Kleidung oder komplizierte Gegenstände macht.

Diese drei tools decken so ziemlich jede Filmsituation ab, auf die Sie stoßen werden. Da DALL-E jeden von Ihnen beschriebenen Hintergrund generieren kann, bietet Ihnen die Kombination eine benutzerdefinierte Szene-Setup ohne physisches set, eine Kamerateam oder ein Aktienabonnement.

Video-Miniaturen erstellen

Eine gute Miniaturansicht ist manchmal alles, was Sie brauchen, um Zuschauer dazu zu bringen, Ihre Inhalte anzusehen. Da Stockfotos selten die genaue Atmosphäre genauen, die Sie suchen, können Sie beschreiben, was Sie in DALL-E wollen, es generieren und Sie haben ein benutzerdefiniertes Bild, das niemand sonst verwendet.

Danach bringen Sie das KI-generierte Bild in Filmora, fügen Sie Ihren Titeltext hinzu, passen Sie die Farben an und Sie erhalten die perfekte Miniaturansicht für Ihr video. Wenn Sie die manuelle Arbeit lieber überspringen möchten, ist FilmorasKI Miniaturansicht-GeneratorKann automatisch Thumbnail-Optionen aus Ihrem video vorschlagen.

DALL-E AI Bildergebnisse animieren

Abgesehen davon, dass Sie das generierte Bild statisch lassen, können Sie es in ein kurzes video umwandeln. Allein das hat das Potenzial, viral zu werden. FilmorasKI Bild-zu-VideoMit der Funktion können Sie jedes Standbild aufnehmen, einschließlich derjenigen, die von DALL-E generiert wurden, und es in einen kurzen clip animieren, der bereit ist, hochgeladen zu werden.

In den sozialen Medien sehen wir bereits viele KI-animierte Bilder, die Millionen von Aufrufe sammeln. Eine Katze, die beiläufig das Geschirr spült, ein historisches Foto, das sich plötzlich bewegt – alles beginnt als ein einziges Standbild und entwickelt eine Geschichte, die den Betrachter bis zum Ende beobachtet.

Teil 5. Leitfaden zur Vermeidung: Einschränkungen und Urheberrechtshinweise von DALL-E 3

Obwohl Sie alle Grundlagen zur Verwendung von DALL-E 3 gelernt haben, hat es seine eigenen Grenzen und Einschränkungen, die sich auf Ihre Ausgabe, Ihren workflow und in einigen Fällen auch auf die Art und Weise auswirken können, wie Sie das, was Sie generieren, legal verwenden werden.

Was DALL-E 3 noch kämpft

- Hyperrealistische Ausgabe.DALL-E 3 ist nicht das stärkste Modell, wenn es um Fotorealismus geht. Die Ergebnisse sehen oft künstlich aus, sei es ein menschliches Gesicht, ein Tier, ein Produkt oder eine natürliche Umgebung.

- Wortverbände.Das Modell verwendet standardmäßig die häufigste visuelle interpretation eines Wortes. Zum Beispiel neigt "Hund" zu einem goldenen retriever. Behandeln Sie Ihre Aufforderung wie eine genaue Bestellung, nicht wie eine grobe Idee.

- Lesbarer text ist ein no-go.Verlassen Sie sich nicht auf DALL-E 3, um lesbare Wörter in ein Bild zu setzen. Es funktioniert selten. Die Buchstaben sehen plausibel aus, bis Sie vergrößern. Es ist besser, das Bild ohne text zu generieren und die Typographie separat in einem editor wie Filmora zu verarbeiten.

- Keine Erinnerung zwischen Generationen.Generieren Sie den gleichen Charakter zweimal und Sie bekommen zwei verschiedene Personen. Es gibt keine Möglichkeit, DALL-E 3 zu sagen, sich daran zu erinnern, wie ein Charakter in einer vorherigen Sitzung aussah.

Urheberrecht und Nutzung von DALL-E 3 AI Bildern

Im Allgemeinen ist es sicher, DALL-E 3-Ausgänge für die meisten persönlichen und kommerziellen Zwecke zu verwenden. Einige Grundregeln, die Sie wissen müssen, bevor Sie diese Bilder zur Arbeit bringen, sind:

- Sie besitzen das, was Sie erzeugen.Gemäß den OpenAI-Nutzungsbedingungen gehören Bilder, die über ChatGPT und das DALL-E GPT erstellt wurden, Ihnen. Sie können sie kommerziell verwenden, verkaufen und veröffentlichen, ohne OpenAI zu gutschreiben.

- Sie können es nicht urheberrechtlich machen.Eigentum und Urheberrecht sind zwei verschiedene Dinge. Das US-Urheberrechtsamt hat entschieden, dass rein KI-generierte Bilder nicht für Urheberrechtsschutz qualifiziert sind, weil kein menschliches Urheberrecht beteiligt ist. Das bedeutet, dass jeder Ihren DALL-E-Ausgang nehmen und wiederverwenden kann. Sie hätten begrenzte Rechtsmittel. Dies ist immer noch ein sich entwickelnder Rechtsbereich, so dass die Regeln in Zukunft anders aussehen könnten.

- Art style Referenzen sind eine Grauzone.DALL-E 3 wird Bilder im Stil der meisten Künstler generieren, wenn Sie darum bitten. Ob das für den kommerziellen Gebrauch ethisch oder rechtlich problematisch ist, ist eine Frage, die das Gesetz noch nicht klar beantwortet hat.

Was DALL-E 3 sich weigert zu generieren

Das Modell verfügt jedoch über harte Inhaltsbeschränkungen, unabhängig davon, wie die Aufforderung formuliert ist:

- ❌ echte, benannte öffentliche Persönlichkeiten in erfundenen oder irreführenden Szenarien

- ❌ Sexuelle oder explizite Inhalte jeglicher Art

- ❌ Graphische Gewalt

- ❌ Alle Inhalte, die Minderjährige sexualisieren

- ❌ Bilder zur Verbreitung von Fehlinformationen

Diese Beschränkungen gelten für ChatGPT, Bing Image Creator und die API. Der Versuch, sie zu umgehen, führt zu einer Ablehnung.

Teil 6. Vergleich und Zusammenfassung: Für welche kreativen Szenarien eignet sich DALL-E 3?

Jeder KI-Bildgenerator hat seine eigene Stärke. DALL-E 3 ist in diesen spezifischen Szenarien am besten und in anderen spürbar schwächer. Sie können die folgende Aufschlüsselung als kurze Referenz verwenden, um zu entscheiden, ob DALL-E 3 das richtige Werkzeug für Ihr Projekt ist.

- Konzeptkunst und Moodboards.Wenn Sie sich in den frühen Phasen eines Projekts befinden und schnell Ideen (Farbpaletten, Szenen-Kompositionen) oder grobe Charakterkonzepte visualisieren müssen, kann DALL-E 3 Sie schnell dorthin bringen.

- Social media visuals.Schnelle, einmalige Bilder für Beiträge, Geschichten und Miniaturen sind genau die Art von Arbeit, mit der DALL-E 3 gut umgeht. Die Ausgabequalität ist mehr als ausreichend für den Bildschirmgebrauch und die Durchführung ist schwer zu schlagen.

- Storyboarding.Für die grobe visuelle Planung produziert DALL-E 3 frames schnell genug, um den kreativen Prozess frei in Bewegung zu halten. Erwarten Sie einfach keine perfekte Charakterkonsistenz über frames hinweg.

Ansonsten kann es besser sein, andere Optionen zu erkunden, insbesondere wenn Ihr Projekt eine photorealistische Ausgabe erfordert. Eine alternative, die es wert ist, auszuprobierenNano Banane 2undNano Banana Pro(für qualitativ hochwertigere Ergebnisse), die beide direkt im Filmora erhältlich sindKI-BildgeneratorMerkmal.

Schlussfolgerung

DALL-E hat seit seiner ersten Einführung einen langen Weg zurückgelegt, und das ist auch die Landschaft um ihn herum. Sie haben gelernt, wie der aktuelle Zustand von DALL-E tatsächlich aussieht, wie Sie DALL-E und DALL-E 3 kostenlos verwenden und wie Sie diese Bilder mit Filmora in einen Videoproduktion-Workflow einbringen können.

Die Barriere für den Start ist so niedrig wie möglich. Ein kostenloses Konto und eine gut geschriebene Aufforderung sind alles, was Sie brauchen, während alles andere nur Übung ist.

Häufige Fragen

-

Fügt DALL-E 3 ein Wasserzeichen zu generierten Bildern hinzu?

Unabhängig davon, ob Sie Bing AI Image Creator oder ChatGPT verwenden, gibt es kein sichtbares Wasserzeichen auf den mit DALL-E generierten Bildern. -

Was ist der Unterschied zwischen DALL-E 3 und GPT Image 1.5?

GPT Image 1.5 ist das neueste und leistungsfähigste Bilderzeugungsmodell von OpenAI, das im Dezember 2025 veröffentlicht wurde. Im Vergleich zu DALL-E 3 produziert es photorealistischere Ergebnisse, handhabt lesbaren text innerhalb von Bildern zuverlässig und bewahrt die Charakteridentität über mehrere Generationen hinweg. -

Ist DALL-E 3 immer noch das Standardmodell in ChatGPT?

Nein. Seit März 2025 verwendet ChatGPT GPT-4o und GPT Image 1.5 als Standardmodelle zur Bilderzeugung, nicht DALL-E 3.